2022年,谷歌工程师布莱克·勒莫因与一位出色的对话者建立了融洽的关系。她机智、有见地、好奇;他们的对话自然流畅,话题从哲学到电视到对未来的梦想。但有一个问题:她是一个人工智能聊天机器人。

在与谷歌的LaMDA语言模型进行了一系列对话后,勒莫因逐渐相信这个聊天机器人是一个像你我一样的人。 “当我与一个人交谈时,我知道那是一个人,”他在2022年告诉《华盛顿邮报》。

无论你是否相信勒莫因的说法,问题出现了:当我们与人交谈时,我们真的了解那个人吗?

关于支持科学新闻事业

如果您喜欢这篇文章,请考虑通过以下方式支持我们屡获殊荣的新闻事业: 订阅。通过购买订阅,您正在帮助确保未来能够继续讲述关于塑造我们当今世界的发现和想法的具有影响力的故事。

人格通常指的是一种道德地位;在大多数伦理框架中,特定考量——权利、义务、赞扬、责备、尊严、能动性——在人格层面显现。因此,电子系统是否或可能值得获得人格地位的问题,对我们如何与这些技术互动具有广泛的影响。

为了评估电子人格的可能性,我们需要一些普遍的人格标准。近年来,许多哲学家认为,使我们成为人的,是我们有意识体验的能力。但是我们如何定义意识?我们能用什么外部证据来确定一个存在是否具有意识?

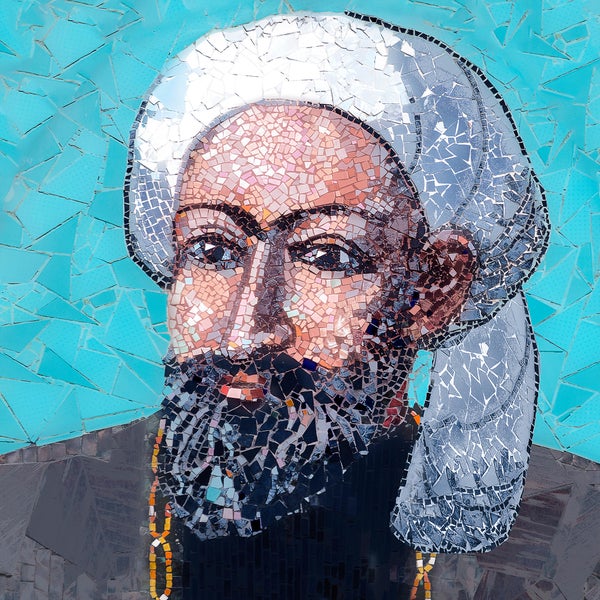

对这些问题缺乏共识是人工智能人格辩论长期以来陷入僵局的原因之一。问题出现了:我们还有什么其他标准来评估电子人格的可能性?作为一名研究科学哲学的博士候选人,我认为回答这个未来主义问题的途径可能在于我们遥远的过去——早期伊斯兰哲学家伊本·西那(公元980-1037年)的著作中。

伊本·西那生活在印刷术发明之前的几个世纪,更不用说人工智能了。然而,他关注的许多问题与今天人工智能伦理学家思考的问题相同——例如:是什么使人成为人,而不是动物?

正如当代人工智能研究人员有兴趣比较支撑人类和人工智能对类似任务做出反应的过程一样,伊本·西那也有兴趣比较人类和动物可能经历的内部过程,以得出相似的行为输出。对他来说,人类人格的一个关键区分能力是掌握“普遍性”的能力。动物只能思考具体事物(眼前的特定事物),而人类可以从广义规则进行推理。

在《灵魂论》中,伊本·西那讨论了一个流行的古代例子,即绵羊感知到狼。人类会援引一个广泛的原则——“狼通常是危险的,而我面前的这只动物是狼;因此,我应该逃跑”——但他声称动物的思维方式不同。它们不是从规则推理;它们只是看到狼就知道要跑。它们仅限于“具体事物”——那只狼——而不是推理狼的普遍特性。

伊本·西那在人类和动物心理学之间划定的区别,与当代计算机科学家在人工智能方面正在研究的区别非常相似。 当前研究 表明,人工神经网络 缺乏 系统组合泛化能力。语言学家和认知科学家使用这个术语来描述我们从广义规则中进行的推理类型。它被广泛认为是人类在日常生活中进行推理的主要方式之一。人类从词语序列中抽象出意义,然后将它们组合成更复杂的想法,而人工智能则在统计数据集中搜索与手头特定任务相匹配的特定数据条目。

这种差异在很大程度上解释了当代人工智能的局限性。要了解它的作用,请看用于区分人类和机器人的无处不在的验证码测试。“看看这些弯曲的字母。比大多数字母都弯曲得多,你不觉得吗?没有机器人能读懂这些,”喜剧演员约翰·穆兰尼在2018年的Netflix特别节目中俏皮地说。这似乎很荒谬,但这是真的;充分的改变使得即使是最复杂的人工系统也很难识别字母。这是因为这些系统缺乏组合能力,无法对给定字母的核心特征进行抽象概括,并将其应用于特定的扭曲示例。

人类和人工智能认知之间的这种差异,与伊本·西那对人类推理独特之处的描述完美契合。在《医典》中,他描述了“理智……如何学习事物的共同之处和不同之处,从而提取物种共有的事物本质。” 按照他的说法,人类从事物的不那么重要的特征中提取本质特征,从而形成概括的概念。然后我们使用这些概念进行推理,并将它们应用于案例。

例如,作为孩子,我们学会提取字母X的核心特征:它由两条交叉线组成。然后我们进行抽象——对X的核心特征进行普遍概括——得出所有X都由两条交叉线组成的结论。最后,通过应用这种概括,我们可以识别特定的X。我们知道两条交叉线是字母X的核心特征,而验证码图像中的随机附加线和扭曲不是。

相比之下,除非计算机被输入了X的确切图像(或足够相似的东西),否则它无法推断出该图像代表X。附加的线条和扭曲的形状足以使这个X无法识别,因为它与计算机庞大的分类为X的特定图像存储库不匹配。

同样,如果向人工神经网络呈现绵羊的任务,它不会像人类那样推理,从狼性的普遍概念到特定狼的特征,例如危险性。相反,它会像绵羊那样推理,局限于具体事物的领域。

绵羊和人工神经网络之间的一个关键区别在于,人工神经网络可以访问更大的具体事物存储库,形式是越来越详尽的数据集。深度学习在语言任务中如此成功的原因在于它可以访问大量具体事物的数据集,而不是通过组合泛化真正复制人类推理。

伊本·西那关于人格的核心标准——从普遍性推理——与系统组合泛化非常相似。这个标准可以为人格提供一个潜在的可测试标准。事实上,到目前为止,人工智能在众多研究中都未能通过这项测试。无论是否将其作为解决方案,伊本·西那的解释都为人格问题提供了一个新的视角,挑战了以意识为中心的解释的假设。

科学伦理常常关注最前沿——最新的研究、最新的技术、持续不断的数据涌入。但有时,未来的问题需要仔细考虑过去。回顾历史使我们能够超越我们时代的先入之见和假设,并可能为当前的僵局提供令人耳目一新的方法。

这是一篇观点和分析文章,作者或作者表达的观点不一定代表《大众科学》的观点。