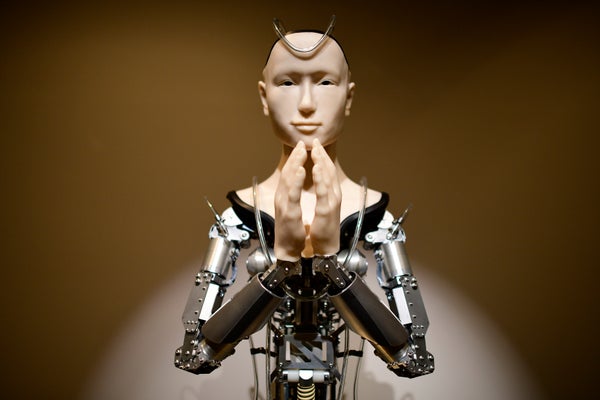

在日本京都的中心地带,坐落着拥有400多年历史的高台寺,寺内装饰着华丽的樱花、传统的莳绘艺术,以及现在一个由铝和硅制成的机器人牧师。

“明达”是一个旨在模仿佛教慈悲女神的机器人牧师,它是不断增长的机器人劳动力的一部分,这种劳动力正在加剧各行各业的职业不安全感。机器人甚至渗透到曾经看似不受自动化影响的领域,如新闻业和心理治疗。现在人们正在辩论机器人和人工智能系统是否可以取代牧师和僧侣。认为这些职业是安全的,是否太天真了?有什么是机器人不能做的吗?

我们认为,有些工作永远不会屈服于机器人霸主。多年来对自动化心理学的研究向我们表明,这种机器仍然缺乏一种品质:可信度。没有可信度,“明达”和其他机器人牧师永远无法超越人类。工程师在设计机器人时很少考虑可信度,但这可能会决定哪些工作无法成功实现自动化。其影响远远超出宗教领域。

关于支持科学新闻报道

如果您喜欢这篇文章,请考虑通过以下方式支持我们屡获殊荣的新闻报道 订阅。通过购买订阅,您正在帮助确保有关塑造我们今天世界的发现和想法的有影响力的故事的未来。

什么是可信度,为什么它如此重要?可信度是能力的对应物。能力描述了你是否能做某事,而可信度描述了人们是否相信你能做某事。可信度是一个人作为真实信息来源的声誉。

科学研究表明,获得可信度需要以一种非常昂贵或不理性的方式行事,如果你不是真的坚持自己的信念。当格蕾塔·桑伯格乘船前往2019年联合国气候行动峰会时,她发出了一个真实的信号,表明人们需要立即采取行动来遏制气候变化。宗教领袖通过朝圣和独身来展示可信度,如果他们不是真正坚持自己的信念,这些做法就没有意义。当宗教领袖失去可信度时,就像在天主教会的性虐待丑闻之后一样,宗教机构会损失金钱和信徒。

机器人能力很强,但它们可能不可信。研究表明,可信度需要真实的信念和为这些信念做出的牺牲。机器人可以布道和撰写政治演讲稿,但它们并不真正理解它们所传达的信念。机器人也不能真正从事像独身这样的代价高昂的行为,因为它们感受不到代价。

在过去的两年里,我们与包括高台寺在内的宗教场所合作,测试这种缺乏可信度是否会损害雇用机器人牧师的宗教机构。我们的假设并非理所当然。“明达”和其他机器人牧师都是奇观,配备了整面墙的视频屏幕和沉浸式音效。“明达”在其布道过程中旋转,以便与观众进行眼神交流,同时双手合十祈祷。游客蜂拥而至体验这些布道。然而,即使有这些特效,我们仍然怀疑机器人牧师是否真的能激励人们感受到对他们的信仰和宗教机构的忠诚。

我们进行了三项相关研究,这些研究在一篇最近发表的论文中有所描述。在我们的第一项研究中,我们在人们离开高台寺时招募了他们。有些人见过“明达”,有些人没有。我们还询问了人们对“明达”和在高台寺工作的人类僧侣的可信度的看法,然后给了他们一个向寺庙捐款的机会。我们发现,人们认为“明达”的可信度低于在高台寺工作的人类僧侣。我们还发现,与那些参观过寺庙但没有观看“明达”的人(80%)相比,看过机器人的捐款给寺庙的可能性降低了12%(68%)。

然后在我们的论文中重复了这一发现两次:在一项后续研究中,我们随机分配道教徒观看人类或机器人宣讲《道德经》中的一段经文。在第三项研究中,我们衡量了基督徒在阅读一篇我们告诉他们是由人类或聊天机器人撰写的布道词后,其主观宗教信仰的虔诚程度。在这两项研究中,人们都认为机器人的可信度低于人类,并且与人类宣讲的布道词相比,他们对自己的宗教身份的忠诚度在机器人宣讲的布道词后也较低。观看机器人宣讲《道德经》的参与者也比观看人类牧师的参与者(30%)在传播寺庙传单的可能性方面低12%(18%)。

我们认为,这些研究具有超越宗教的意义,并预示了自动化的局限性。目前关于自动化未来的讨论都集中在能力上。网站“机器人会抢走我的工作吗?”使用关于机器人能力的数据来估计任何工作很快被自动化的可能性。在最近的社论中,新加坡管理大学的管理人员认为,在人工智能时代,就业的最佳途径是培养“独特的人类能力”。

然而,仅仅关注能力可能会使我们看不到机器人因不可信而表现不佳的领域。

这种机器人可信度惩罚目前正在从新闻业到医疗保健、法律、军事和自动驾驶汽车等领域感受到。机器人可以胜任地执行这些领域的活动。但它们未能激发信任,而信任至关重要。人们不太可能相信人工智能生成的新闻标题,并且他们不希望机器在无人机袭击或车祸中做出关于谁生谁死的道德决定。

教育也可能受到可信度惩罚的影响。可汗学院发布了在线学生教育工具,最近发布了一个名为Khanmigo的生成式人工智能,它提供发展性反馈,而不是直接给学生答案。但是这些程序会奏效吗?

就像虔诚的人需要一位为自己的信仰做出牺牲的领袖一样,学生需要以身作则的榜样,他们真诚地关心他们所教的内容。他们需要胜任且可信的老师。因此,自动化教育可能会进一步扩大 教育不平等。来自富裕背景的学生将有机会获得人工智能辅助的人类教师,而来自贫困背景的学生最终可能会进入完全由人工智能授课的课堂。

政治和社会行动主义是可信度至关重要的其他领域。想象一下机器人试图发表亚伯拉罕·林肯的葛底斯堡演说或马丁·路德·金的“我有一个梦想”演讲。这些演讲之所以如此有力,是因为它们充满了作者真实的痛苦和爱。

如果需要可信度的工作找到一种方法,将人工智能能力与人类可信度结合起来,而不是取代人类工作者,那么这些工作将更有效地运作。人们可能不信任机器人记者和教师,但他们会信任在这些角色中使用人工智能辅助的人类。

正确预测工作的未来需要认识到哪些职业需要人情味,并保护这些领域的人类雇员。在急于推进人工智能技术的过程中,我们必须记住,有些事情是机器人做不到的。

这是一篇观点和分析文章,作者或作者表达的观点不一定代表《大众科学》的观点。